Fotografija dekleta, ki zažiga letak Gibanja Svoboda, je lažna

Avtorici: Eva Gračanin, Nina Rozman

Po podatkih evropskega observatorija za digitalne medije (EDMO) je delež z umetno inteligenco ustvarjenih ali preoblikovanih dezinformacij januarja letos dosegel rekord. Od 1633 člankov, ki so jih v tem mesecu preverili člani EDMA, je bilo takih 20 odstotkov. Foto: Jakob Pintar/STA

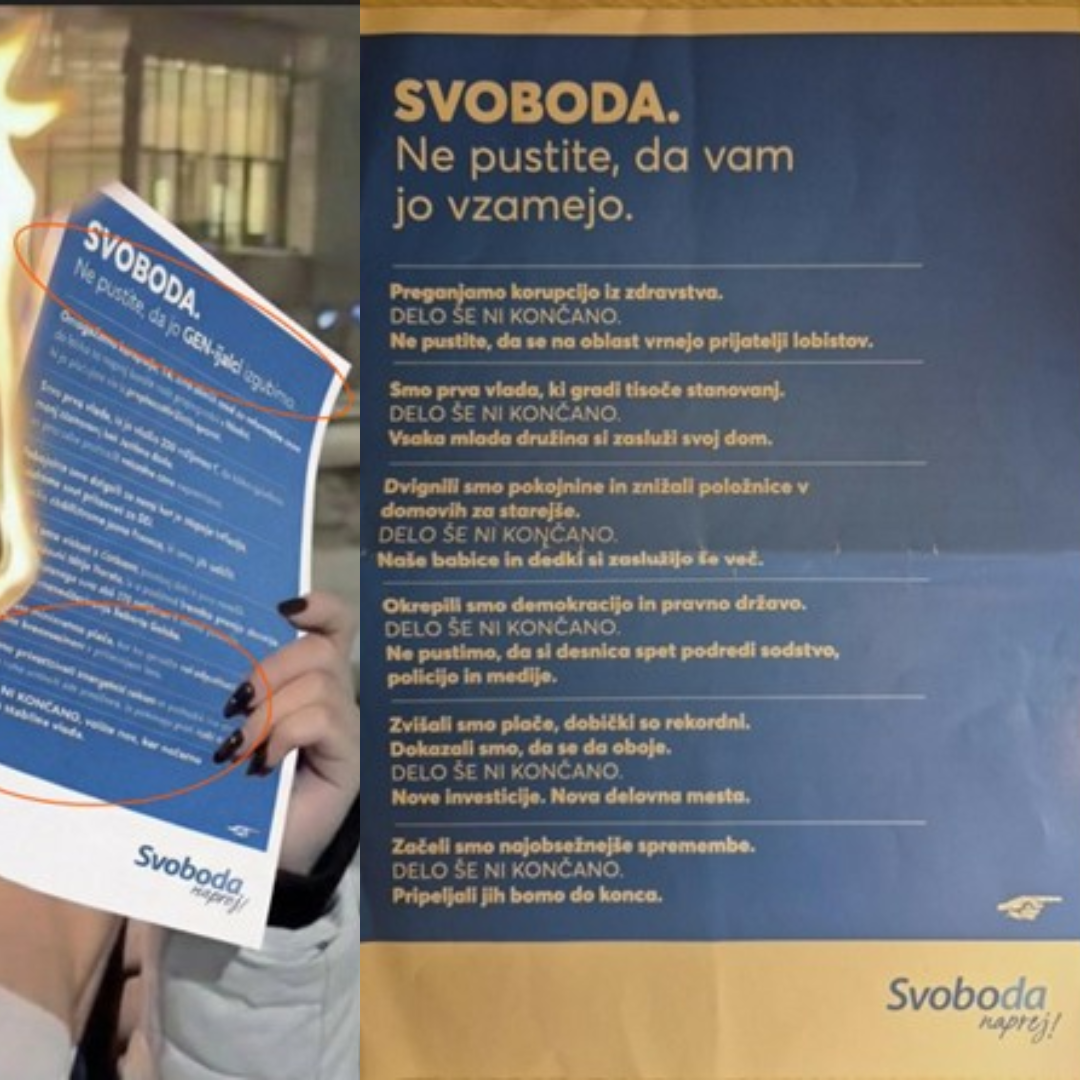

Domnevna uporabnica omrežja X ꞌAjda Medjaꞌ je 19. februarja objavila fotografijo dekleta, ki s cigareto zažiga predvolilni letak stranke Gibanje Svoboda. Objava je imela do zaključka redakcije 5100 ogledov, všečkalo jo je 443 uporabnikov, delilo pa 118.

Pregled komentarjev, ki so jih uporabniki pustili pod objavo, je pokazal, da nekateri niso prepoznali neavtentičnosti fotografije. »Bravo, Ajda. Vse, kar ti Svobodnjaki nakladajo, je dim in prevara,« se je v komentarjih pod fotografijo denimo odzval eden od uporabnikov.

Po podatkih statističnega urada med prebivalkami Slovenije sicer ni osebe z imenom Ajda in priimkom Medja, torej z imenom, s katerim se predstavlja domnevna uporabnica omrežja X, ki je delila omenjeno fotografijo.

Na Razkrinkavanju.si smo verodostojnost fotografije preverili z orodjem Hive, ki je pokazalo 99,4-odstotno verjetnost, da je bila fotografija ustvarjena z modeli generativne umetne inteligence.

Primerjava letaka na fotografiji z omrežja X in tiskane različice letaka. Foto: zaslonski posnetek/Razkrinkavanje.si

Ko smo vsebino predvolilnega letaka na fotografiji primerjali z njegovo tiskano različico, smo ugotovili, da se deli besedila med seboj ne ujemajo.

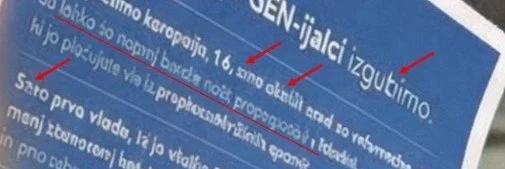

Mladen Borovič, ki je na mariborski fakulteti za elektrotehniko, računalništvo in informatiko (FERI) med drugim asistent pri predmetu Umetna inteligenca, je potrdil, da je bila fotografija dekleta ustvarjena z orodjem generativne umetne inteligence, saj so na njej napake, najbolj opazne so v besedilu na gorečem letaku.

Tudi po oceni Boruta Batagelja, asistenta na ljubljanski fakulteti za računalništvo in informatiko (FRI), ki raziskuje področje umetne inteligence, strojnega učenja in razpoznavanja vzorcev, je velika verjetnost, da je fotografijo dekleta ustvarila generativna umetna inteligenca. Najbolj očiten znak je nesmiselno besedilo na letaku, ki vsebuje nenavadno prerazporeditev črk, kar je, kot je pojasnil, značilna napaka generativnih modelov umetne inteligence.

Zaslonski posnetek podrobnosti na fotografiji dekleta z letakom, na katerem je dr. Batagelj označil napake, ki kažejo, da gre za umetno ustvarjeno vsebino. Vir: Borut Batagelj/FRI

Opozoril je tudi na manjše nepravilnosti v podrobnostih fotografije, denimo na robovih papirja letaka, v prehodih med ognjem in papirjem ter neskladja okoli robov dekletovih prstov. »Pri umetno ustvarjenih slikah se pogosto pojavljajo tudi rahlo nenaravni prehodi tekstur ali svetlobe, saj model fizikalnih procesov, kot je gorenje papirja, ne posnema povsem realistično.«

Zaslonski posnetek, na katerem je dr. Batagelj izpostavil napake, ki kažejo, da gre za umetno ustvarjeno fotografijo. Vir: Borut Batagelj/FRI

Kot je pojasnil Batagelj, so nekatere napake opazne tudi v ozadju fotografije. Med drugim so elementi ponekod nejasni in prostorsko nedosledni, nekateri objekti na fotografiji pa nimajo jasno prepoznavne funkcije ali strukture. Pravi, da je to pogosto značilno za umetno ustvarjene fotografije, katerih glavni motiv je lahko precej prepričljiv, sekundarni elementi, predvsem tisti v ozadju, pa so slabše definirani ali logično neskladni.

Po poročanju več portalov, ki so tako kot Oštro verificirani podpisniki kodeksa mednarodne mreže za preverjanje dejstev (IFCN), so podobne fotografije dekleta na družbenih omrežjih zakrožile že januarja letos.

Kot je 19. januarja poročal poljski portal Demagog, je kanadska uporabnica v tistem mesecu na omrežju X objavila video dekleta, ki s cigareto protestno zažiga fotografijo pokojnega iranskega verskega in političnega voditelja ajatole Alija Hameneja. Iz tega videoposnetka so pozneje nastali zaslonski posnetki oziroma fotografije, ki krožijo po spletu. Ena izmed teh je bila najverjetneje uporabljena za produkcijo fotografije, ki jo je objavila ꞌAjda Medjaꞌ.

Po ugotovitvah španskega portala za preverjanje dejstev Maldita se ozadje videoposnetka ujema s prizoriščem v mestu blizu Toronta. Po poročanju britanskega portala Full Fact je avtorica izvirne fotografije januarja v intervjuju za portugalsko tiskovno agencijo Lusa potrdila, da je video nastal v Kanadi.

Orodje za boj proti ekstremizmu v rokah skrajne desnice

Lik podobnega dekleta z imenom ꞌAmeliaꞌ, ki v videoposnetkih na družbenih omrežjih širi izrazito negativna in skrajno desna sporočila, se je pojavil tudi v Angliji. Britanski časnik Guardian je januarja lani poročal, da gre za z umetno inteligenco ustvarjen lik, sprva razvit za izobraževalno videoigro Pathways, katere razvoj je sofinanciralo britansko notranje ministrstvo, da bi mlade opozorilo na nevarnosti radikalizacije. Lik so pozneje prevzele spletne skupnosti, ga vsebinsko preoblikovale in začele uporabljati za promocijo skrajne desnice.

Po mnenju Mojce Pajnik, profesorice na katedri za medijske in komunikacijske študije na fakulteti za družbene vede in raziskovalke na Mirovnem inštitutu, primer ꞌAmelieꞌ lepo kaže, kako hitro je mogoče sintetične podobe odlepiti od izvirnega konteksta in jih uporabiti za politično mobilizacijo v drugačnem kontekstu.

Pojasnila je, da gre tako v slovenskem kot britanskem primeru za novo obliko »digitalne, sintetične propagande«, ki zmanjšuje stroške izdelave in omogoča hitro prilagajanje vsebin za poglabljanje polarizacije. Omenjena propaganda se od klasične razlikuje v tem, da generativna umetna inteligenca omogoča skoraj industrijsko proizvodnjo politično učinkovitih podob – brez dejanskega dogodka, resnične fotografije ali konkretnega pričevanja.

Vtis, ustvarjen z vizualnimi sporočili, se težko popravi

Mojca Pajnik je še pojasnila, da imajo vizualna sporočila v političnem komuniciranju močen učinek.

Opozorila je, da umetno ustvarjene fotografije v predvolilnih kampanjah delujejo na ravni prvega vtisa in čustvenega odziva, s čimer hitro utrjujejo politične stereotipe in diskreditirajo kandidate. Kot je pojasnila, gre za neke vrste čustvene sprožilce, ki uporabnikov ne prepričujejo z argumentom, ampak s poistovetenjem. Ponudijo jim sliko, ki potrjuje njihovo politično pripadnost ali pa utrjuje odpor do političnega nasprotnika: »Ko se takšna podoba enkrat vključi v politični tok, postane del širšega boja za interpretacijo realnosti.«

Po njenih besedah je v primeru dekleta, ki naj bi zažgalo letak Gibanja Svoboda, dodatno pomembno, da je podoba prilagojena lokalnemu političnemu kontekstu. Uporabniki so iz vizualnega motiva, ki je že krožil po spletu, odstranili izvirni pomen in ga preoblikovali v protistrankarsko sporočilo. To kaže, kako je mogoče isto vizualno vsebino reciklirati in prevesti v nove politične kontekste, s čimer dobi specifičen politični pomen, je pojasnila.

Podobe, ustvarjene z umetno inteligenco, lahko vzbudijo manj toksične odzive kot klasična propaganda, saj so pogosto zabavne, memetične in ironične, zato lažje vstopijo v vsakdanjo rabo in skozi humor normalizirajo skrajna politična sporočila. Uporabniki takšnim podobam verjamejo, ker potrjujejo njihovo pristranskost. K temu prispeva tehnična dovršenost orodij umetne inteligence, ki iz vsebin brišejo napake, kot so popačeni obrazi in nesimetričnost.

Drugi dejavnik, ki spodbuja zaupanje v tovrstne vsebine, pa je logika družbenih omrežij, na katerih vizualne vsebine z močnim čustvenim nabojem dosegajo velike množice, njihovo množično deljenje pa ustvari vtis verodostojnosti, je pojasnila.

ꞌAjdo Medjaꞌ smo seznanili z našimi ugotovitvami. Njen odziv bomo objavili, ko ga prejmemo.

S K L E P

Domnevna uporabnica družbenega omrežja X ꞌAjda Medjaꞌ je 19. februarja objavila fotografijo dekleta, ki s cigareto zažiga predvolilni letak stranke Gibanje Svoboda.

Na Razkrinkavanju.si smo verodostojnost fotografije preverili z orodjem Hive, ki je pokazalo 99,4-odstotno verjetnost, da je bila ustvarjena z uporabo umetne inteligence. Primerjava vsebine predvolilnega letaka na fotografiji in njegove tiskane različice je pokazala, da se deli besedila med seboj ne ujemajo.

Mladen Borovič z mariborske fakultete za računalništvo in informatiko je potrdil, da je bila fotografija ustvarjena z orodjem generativne umetne inteligence. To kažejo napake, ki so najbolj očitne v besedilu na gorečem plakatu.

Tudi po oceni Boruta Batagelja z ljubljanske fakultete za računalništvo in informatiko je velika verjetnost, da je fotografijo dekleta ustvarila generativna umetna inteligenca. Po njegovem to dokazujejo nesmiselno besedilo letaka, nenaravni prehodi tekstur in svetlobe ter zamegljeno ozadje fotografije.

Po poročanju več portalov, ki so tako kot Oštro verificirani podpisniki kodeksa IFCN, so fotografije dekleta, ki zažiga fotografijo politika, na družbenih omrežjih zakrožile že januarja letos.

Mojca Pajnik, profesorica na FDV in raziskovalka na Mirovnem inštitutu, je pojasnila, da imajo vizualna sporočila v političnem komuniciranju močen učinek, saj delujejo na ravni prvega vtisa in čustvenega odziva, s čimer utrjujejo politične stereotipe in diskreditirajo kandidate. Pojasnila je še, da gre za novo obliko »digitalne, sintetične propagande«, ki ima nizke stroške izdelave in omogoča hitro prilagajanje vsebin za poglabljanje polarizacije.

Objavo po metodologiji Razkrinkavanja.si označujemo za lažno.

Etično obvestilo: Čeprav je Mojca Pajnik članica strokovnega sveta zavoda Oštro, ni na noben način vplivala na izbor teme, novinarsko delo ali uredniško vodenje pri obdelavi predmetne teme. Člani odborov zavoda Oštro nimajo ne pravice, ne dolžnosti, ne možnosti vplivanja na delo uredništva, ki vselej deluje neodvisno in samostojno.

Lažna objava

Objava, ki vsebuje lažne informacije, podatke ali trditve. S to oceno ovrednotimo le tiste vsebine, pri katerih je mogoče ugotoviti, da so bile ustvarjene za namerno zavajanje in napačno obveščanje javnosti.